¿POR QUÉ OCURREN LOS ERRORES? EL MODELO DE QUESO DE GRUYERE DE JAMES REASON

A primera vista, podría parecer que un trozo de queso y un error humano no tienen nada en común. Pero el modelo del queso de Gruyère, desarrollado por James Reason, nos muestra lo contrario.

James Reason era un psicólogo británico especializado en seguridad humana y errores organizacionales. Su modelo más conocido explica cómo los fallos individuales pueden desembocar en catástrofes cuando se combinan con debilidades del sistema.

EL MODELO DEL QUESO DE GRUYERE

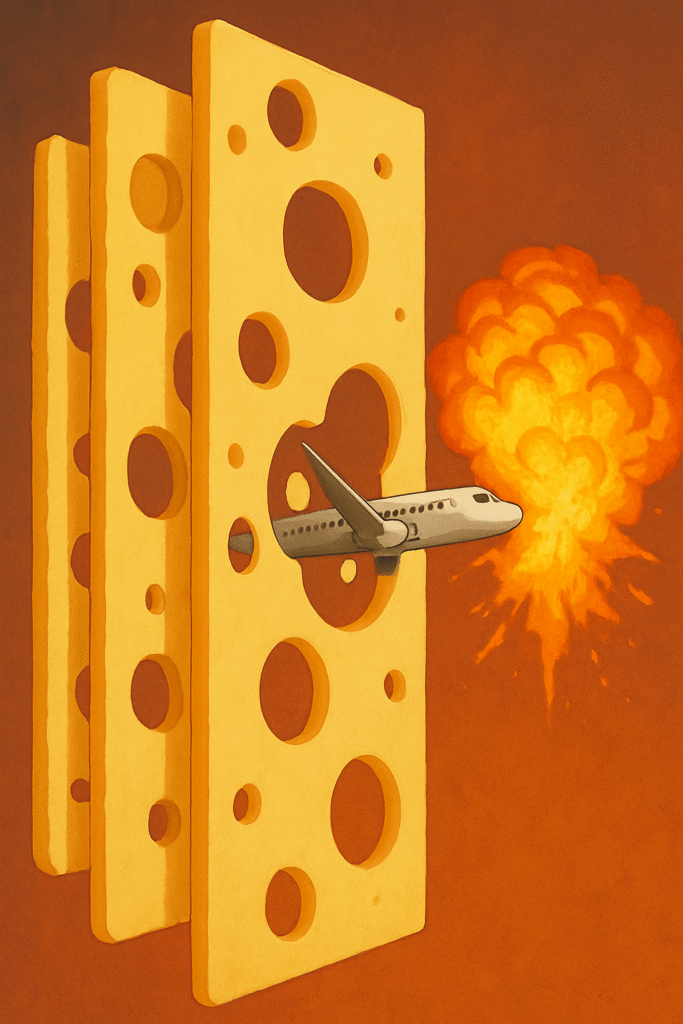

Imagina varias lonchas de queso Gruyère colocadas una tras otra, como si fueran capas protectoras dentro de un sistema complejo. Cada loncha representa una barrera de seguridad: procedimientos establecidos, formación del personal, tecnología, normativas, supervisión, etc. En conjunto, estas defensas tienen como objetivo evitar que ocurran errores graves o accidentes.

Sin embargo, ninguna de estas barreras es infalible. Como el queso Gruyère, cada loncha tiene agujeros. En este caso, los agujeros simbolizan debilidades o fallos: cansancio, distracciones, falta de experiencia, errores de comunicación, omisiones, presión de tiempo, condiciones externas…

La clave está en que estos agujeros no están siempre en el mismo sitio ni tienen el mismo tamaño. A veces, un error se topa con una defensa que lo detecta y lo detiene. Pero otras veces, por azar o por una combinación de factores, los agujeros de varias capas se alinean. Y entonces se abre un camino libre: un túnel por donde el fallo puede avanzar sin que ninguna defensa lo frene. Es en ese momento cuando el sistema falla, y puede producirse un accidente o un error grave.

Este enfoque se conoce como el modelo del queso suizo, propuesto por el psicólogo James Reason. Es una forma muy visual y útil de entender cómo los accidentes no suelen deberse a un solo error, sino a una cadena de fallos que, al alinearse, dejan al sistema sin protección.

Y aunque este modelo se aplica muy a menudo en el ámbito de la aviación, también es válido para muchos otros sectores donde la seguridad y la precisión son esenciales: la sanidad, la educación, la industria, los servicios de emergencia, el transporte…

La lección principal es esta: no basta con confiar en una sola capa de defensa. Es necesario reforzar cada barrera, identificar sus posibles agujeros y estar atentos a cómo pueden interactuar entre sí. Porque prevenir un accidente muchas veces no es cuestión de un gran gesto heroico, sino del trabajo constante para que los agujeros no se alineen.

En la siguiente sección podrás ver un ejemplo de un accidente real en el ninguno de los errores por sí solo causaría una catástrofe, pero al coincidir y no ser detectados a tiempo, desencadenaron un accidente con un resultado devastador: 71 personas perdieron la vida.

EL ACCIDENTE DE ÜBERLINGEN

"El error humano es inevitable. El accidente, no." James Reason

En julio del año 2002 tuvo lugar una de las tragedias aéreas más sobrecogedoras de Europa. Dos aviones —uno de pasajeros y otro de carga— colisionaron en pleno vuelo sobre el sur de Alemania. En total, murieron 71 personas, entre ellas 45 niños que viajaban en un vuelo escolar.

Aquella noche, varios factores se alinearon de forma trágica. En el centro de control aéreo solo había un controlador de servicio; su compañero estaba de descanso. El sistema de radar secundario se encontraba en mantenimiento, lo que dificultaba la detección precisa de los aviones. Además, las instrucciones que recibieron los pilotos eran contradictorias: el sistema automático de prevención de colisiones (TCAS) indicó una maniobra, mientras que el controlador humano dio una orden contraria. El avión de carga obedeció al sistema TCAS, como establecen los protocolos internacionales; el avión de pasajeros, en cambio, siguió las instrucciones del controlador. Cada una de estas fallas fue un «agujero» en una capa de protección. Cuando se alinearon… el accidente fue inevitable. El resultado fue una colisión en el aire, con consecuencias fatales.

Pero la tragedia no terminó ahí.

Uno de los pasajeros fallecidos era una mujer que viajaba con sus dos hijos pequeños. Su esposo y padre de los niños, al recibir la noticia y conocer los detalles del accidente, quedó profundamente traumatizado. Incapaz de soportar el dolor y la injusticia de lo ocurrido, dos años después se presentó en la casa del controlador aéreo que estaba de servicio aquella noche. Al no obtener de él la respuesta emocional que esperaba, en un acto desesperado, lo apuñaló y lo mató.

Este caso no solo pone de manifiesto la complejidad de los sistemas de seguridad y cómo pequeños fallos pueden encadenarse hasta desembocar en una catástrofe, sino también el impacto humano que queda tras el accidente: familias rotas, duelos imposibles y cicatrices que duran toda una vida.

Los errores no ocurren por una sola causa. Prevenirlos implica reforzar cada capa del sistema. Porque cuando entendemos cómo funciona el error, podemos crear sistemas más seguros.